Nemrég megjelent a KTransformers 0.5.3. Ez a framework a nagy nyelvi modellek (LLM-ek) hatékony inferenciájára és finomhangolására készült, különös tekintettel a CPU–GPU heterogén számításra. A kiadásnak köszönhetően a KTransformers 0.5.3 már azokhoz a CPU-khoz is jobban illeszkedik, amelyekből hiányzik az Advanced Matrix Extensions (AMX) és az AVX-512, mivel mostantól néhány, csak AVX2-t igénylő kernelt is kínál.

A KTransformers 0.5.3 bevezeti a kizárólag AVX2-re épülő inferencia-támogatást a Mixture of Experts (MoE) modellekhez. Az AVX2-es inferencia elérhető BF16, FP8 és GPTQ-INT4 MoE terhelésekhez is. Ez nagy előrelépés a jelenlegi és a közelmúltbeli Intel Core (Ultra) processzoroknál, amelyekből hiányzik az AVX-512, különösen a legújabb, AMX-et és AVX-512-t kínáló Xeon szerverekhez, illetve az AVX-512-t szintén támogató AMD Zen 4/5 CPU-khoz viszonyítva. Természetesen egy AVX-512-t vagy AMX-et támogató CPU-val jóval nagyobb, CPU-alapú AI-inferencia teljesítmény érhető el.

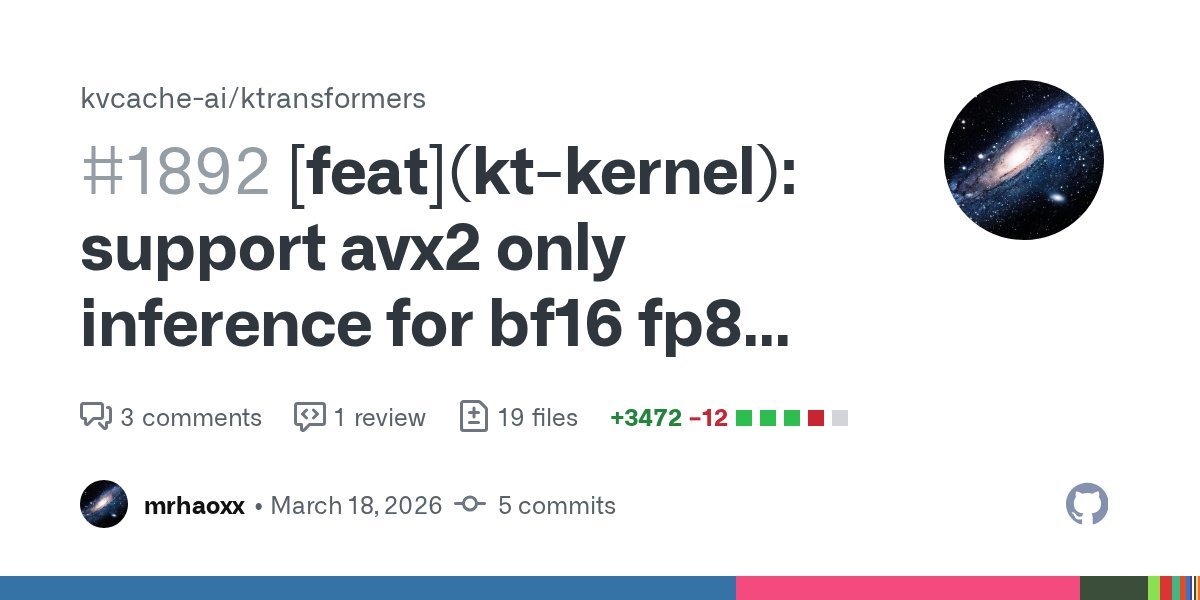

Ez a pull request vezette be nemrég az AVX2-es inferencia támogatását a kt-kernel számára. Ez az új dokumentációösszefoglalja, hogyan futtatható a KTransformers AVX2-es processzorokon.

A KTransformers 0.5.3 emellett NUMA-tudatos telepítési fejlesztéseket is hoz: pontosabb NUMA-leképezést többfoglalatos környezetekben, kisebb üresjárati CPU-terhelést, jobb spekulatív dekódolást, valamint számos egyéb fejlesztést.

Akiket érdekel, a KTransformers 0.5.3 letöltéseit és a kiadás minden részletét itt találják: GitHub.